Home » Qu’est-ce que la détection d’objets maritimes par l’IA ?

La détection d’objets est l’un des problèmes les plus fondamentaux et les plus difficiles à résoudre dans le domaine de la vision par ordinateur. Il s’agit d’identifier et de localiser des instances de classes d’objets prédéfinies (telles que des bateaux, des humains, des animaux) dans des images numériques.

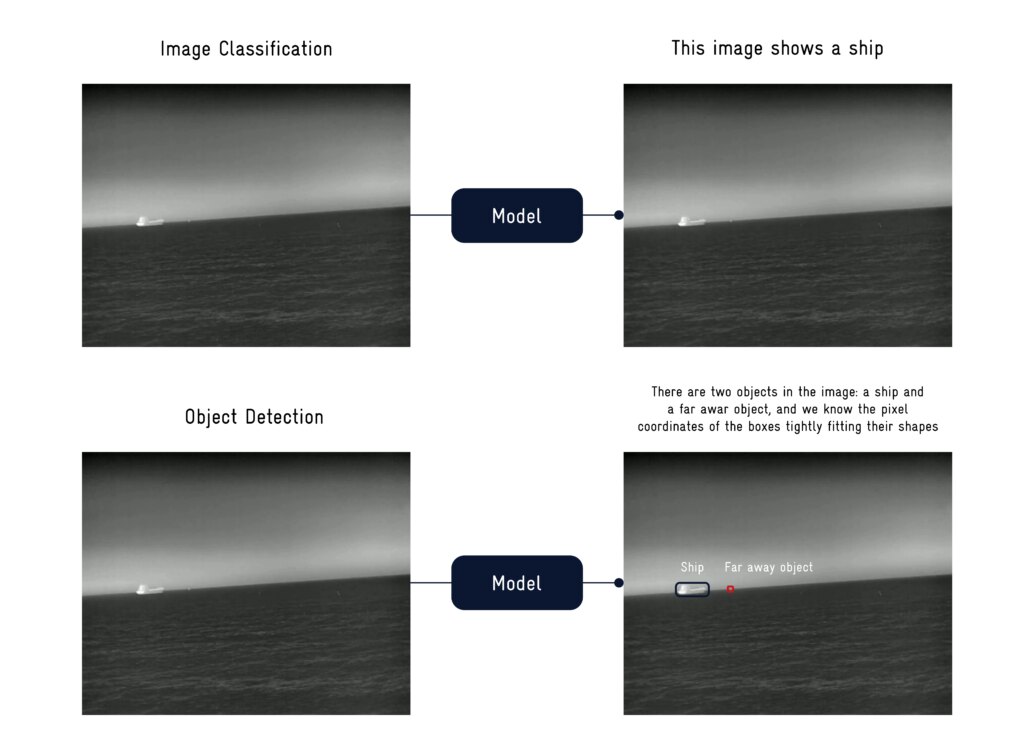

Par rapport à la classification d’images, la détection d’objets fournit plus d’informations sur le contenu d’une image. L’exemple suivant le démontre.

La détection d’objets ne répond pas seulement à la question « Quel objet se trouve dans l’image ? », mais aussi à la question « Combien d’objets se trouvent dans l’image ? ». Si le modèle peut prédire plusieurs classes, il pourrait même dire « bateau » et « objet éloigné », mais c’est le maximum d’informations que nous puissions en tirer.

La classification d’images se limite à dire ce qui est présent dans une image sans préciser la position de chaque objet. Par exemple, elle pourrait prédire qu’une image contient un bateau ou une bouée, mais sans indiquer où ces objets se trouvent. La détection d’objets, en revanche, fournit à la fois les étiquettes et les coordonnées spatiales (boîtes englobantes/bounding boxes) de toutes les instances d’objets détectées dans l’image.

Bien entendu, cette réponse est plus utile dans de nombreux scénarios réels, tels que la prévention des collisions.

Ces réponses, également appelées prédictions, sont générées par des modèles. De nos jours, les modèles sont des réseaux neuronaux profonds (DNN).

Il existe plusieurs types de réseaux neuronaux profonds, mais deux d’entre eux dominent les tâches telles que la détection d’objets. La méthode d’apprentissage profond la plus fondamentale pour la vision par ordinateur utilise les réseaux neuronaux convolutifs (CNN).

Les chercheurs ont inventé l’architecture des CNN en 1980. Cependant, l’article qui a popularisé les CNN profonds n’est apparu qu’en 2012, avec la présentation d AlexNet.

Depuis lors, les CNN sont un ingrédient fondamental de la vision par ordinateur. Il y a quelques années seulement, en 2017, des chercheurs de Google ont présenté les modèles Transformer, qui sont devenus très populaires en raison de leurs excellentes performances en matière de détection.

Néanmoins, ils n’ont pas totalement remplacé les CNN, car les Transformers ont tendance à être plus lents, à nécessiter plus de données pour l’apprentissage et à exiger une plus grande puissance de calcul.

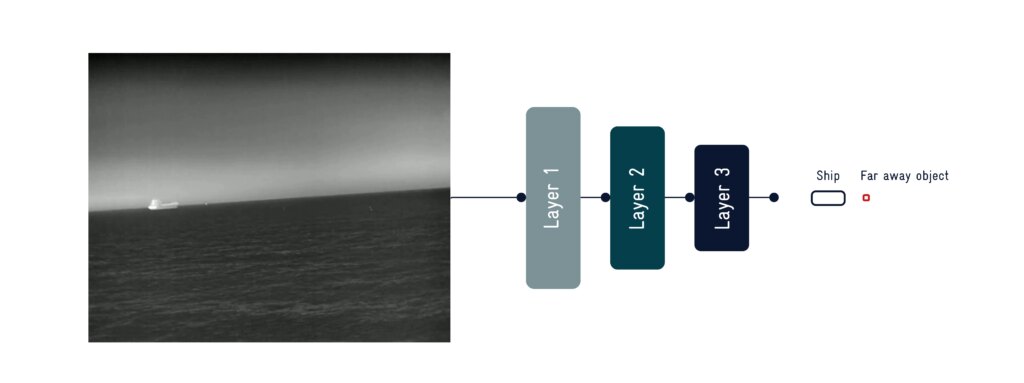

Ces modèles sont constitués de plusieurs couches superposées.

Lorsque vous introduisez une image dans le modèle, chaque couche la traite, et chaque couche transmet son résultat à la suivante.

Le terme « profond » dans l’apprentissage profond fait référence à la présence d’un grand nombre de ces couches. La figure ci-dessous présente un schéma très simplifié de l’empilement de ces couches.

Dans la pratique, les modèles contiennent beaucoup plus de couches, différents types de couches et d’autres types de connexions et d’opérations de traitement.

De manière très simplifiée, on peut considérer chaque couche comme un calcul utilisant l’addition et la multiplication.

Chaque couche se compose de plusieurs paramètres, qui sont essentiellement des nombres simples que ces opérations mathématiques utilisent.

En termes de nombre total de paramètres par modèle, les réseaux DNN de détection d’objets peuvent varier considérablement – de 2,4 millions de paramètres (YOLO26 nano, un modèle basé sur le CNN) à 218 millions de paramètres (une version DINO utilisant une épine dorsale SwinL, un modèle basé sur un transformateur).

Pour obtenir un modèle qui fasse de bonnes prédictions, vous devez l’entraîner. Intuitivement, au cours de ce processus, le modèle apprend à quoi ressemblent certains types d’objets et comment les détecter correctement.

Dans l’apprentissage profond, ce sont les données qui déterminent le processus de formation. Cela signifie qu’au lieu d’indiquer explicitement au modèle l’apparence de certains types d’objets (ce qui est pratiquement impossible), nous lui fournissons de grandes quantités de données et les prédictions souhaitées (appelées « vérité de terrain »).

Sur la base de ces deux facteurs, le modèle apprend à générer les meilleures prédictions. Bien que cela puisse sembler magique, il s’agit essentiellement de mathématiques : le modèle apprend les valeurs optimales des paramètres par le biais d’un processus d’optimisation mathématique.

En effet, il apprend une fonction mathématique non linéaire très complexe qui résume au mieux les données fournies. Il n’est donc pas surprenant qu’un ensemble de données de haute qualité soit essentiel pour obtenir un modèle fiable et des résultats de détection corrects.

Nous divisons généralement l’ensemble de données en trois sous-ensembles :

Cette séparation permet de mesurer objectivement les performances et d’apporter des améliorations itératives à des aspects clés tels que la vitesse de détection, la résistance aux objets multi-échelles (tailles et distances variables) et la précision globale.

Afin d’améliorer en permanence les performances du modèle, l’ensemble des données doit être régulièrement enrichi. Les données sont collectées dans des environnements opérationnels réels et dans diverses conditions afin de garantir la robustesse du modèle face à un large éventail de scénarios.

Le processus complet de collecte de données est détaillé ici : Comment collecter des données pour la formation à l’IA ?

Dans le cas de l’utilisation maritime, la taille des objets présente une difficulté particulière. Souvent, les objets sont relativement éloignés, ce qui fait qu’ils apparaissent avec peu de détails dans l’image.

Considérez l’image ci-dessous : des objets existent clairement dans chaque culture, mais à quelles catégories correspondent ces objets ?

Au bout d’un certain temps, on peut deviner que le côté droit représente un bateau à voile et le côté gauche une bouée sphérique.

Cependant, il ne s’agit pas d’une distinction triviale (même forme sphérique, même couleur dans les images LWIR, etc.) C’est pourquoi, dans de tels cas, il est particulièrement important de disposer d’un vaste ensemble de données de haute qualité, afin que le modèle puisse apprendre les distinctions appropriées. Une fois de plus, cela montre pourquoi nous accordons tant d’importance à la qualité de l’ensemble de données.

La détection d’objets se concentre sur la localisation (où ?) et la classification (quoi ?) de tous les objets d’une image. Pour ce faire, elle effectue une opération mathématique complexe à partir de l’image.

Bien que les opérations mathématiques soient complexes et impliquent généralement des millions de paramètres, l’objectif est simple : détecter de manière robuste tous les objets d’une image.

Dans notre cas, il s’agit de la base d’une prévention réussie des collisions en mer.

SEA.AI se développe en Amérique du Nord, avec une nouvelle équipe, un meilleur support et une plus grande disponibilité. Nous renforçons notre présence en Amérique du Nord avec de nouveaux talents, un soutien accru et un accès plus large à nos systèmes de sécurité.

La détection vous dit ce qui est en mer. Le suivi multi-objets vous dit ce qu’est chaque objet, d’où il vient et où il va, pour chaque objet de la scène simultanément. C’est la différence entre un instantané et un renseignement opérationnel.

La surveillance maritime dépend de l’AIS et du radar. Quand l’un ou l’autre est défaillant, masqué ou brouillé, l’image opérationnelle disparaît. L’intelligence visuelle par IA est la réponse à cet écart.